وقتی با مدلهای زبان بزرگ (LLM) کار میکنید، احتمالاً دیدهاید که گاهی بدون راهنمایی مرحلهبهمرحله، پاسخها ناقص یا اشتباه میشوند.

اینجاست کهChain-of-Thought Prompting (CoT) وارد میشود؛ تکنیکی که مدل را وادار میکند مثل انسان فکر کند و هر گام استدلال خود را توضیح دهد تا به پاسخ نهایی برسد.

ایده اصلی CoT چیست؟

- CoT فرآیند حل مسائل پیچیده را به مراحل کوچکتر و قابل مدیریت تقسیم میکند.

- مدل هر مرحله را جداگانه تحلیل میکند و یک زنجیره منطقی از استدلالها ایجاد میکند که در نهایت به پاسخ درست منتهی میشود.

- این روش باعث میشود پاسخها شفاف، منطقی و قابل اعتماد باشند.

مثال ساده

پرامپت معمولی:

<آسمان چه رنگی است؟>

پاسخ مدل:

«آبی است.»

پرامپت CoT:

«لطفاً توضیح بده چرا آسمان آبی است و مراحل استدلال خودت را مرحله به مرحله شرح بده.»

پاسخ مدل با CoT :

1️⃣ تعریف «آبی» به عنوان یک رنگ اصلی

2️⃣ بررسی نحوه جذب نور توسط جو زمین

3️⃣ نتیجهگیری: به دلیل جذب سایر طول موجها، آسمان آبی به نظر میرسد

همانطور که میبینید، با CoT میتوان کل مسیر فکری مدل را دنبال کرد، نه فقط پاسخ نهایی.

چگونه CoT را در پرامپتها استفاده کنیم؟

- کافی است عباراتی مانند:

«Explain your reasoning step-by-step»

یا

«Describe your answer and reasoning process»

را به انتهای پرامپت اضافه کنید.

- مدل سپس نه تنها پاسخ میدهد، بلکه زنجیره استدلال خود را هم نشان میدهد.

- این روش کمک میکند خطاها راحتتر شناسایی شوند و عملکرد مدل قابل بررسی باشد.

.

حالا بیایم بیشتر و مفصل تر این مبحث رو باز کنیم

Chain-of-Thought Prompting چیست؟

Chain-of-Thought یعنی تقسیم مسائل پیچیده به مراحل کوچکتر و تحلیل هر مرحله به صورت جداگانه. این کار پاسخها را دقیقتر و قابلفهمتر میکندپ

تفاوت CoT با پرامپت معمولی:

• در پرامپتهای معمولی، مدل مستقیماً به پاسخ نهایی میپردازد.

• در CoT، مدل ابتدا مراحل و استدلال را شرح میدهد و سپس نتیجه را اعلام میکند؛ بنابراین میتوان مسیر فکر کردن مدل را دنبال کرد و خطاها را پیدا کرد.

| نوع پرامپت | ورودی به مدل | پاسخ مدل |

| پرامپت معمولی | >جمع ۱۲۳۴ و ۵۶۷۸ چیست؟< | ۶۹۱۲ )فقط جواب نهایی( |

| پرامپت CoT | لطفاً مراحل محاسبه جمع ۱۲۳۴ و ۵۶۷۸ را مرحله به مرحله توضیح بده | 1️⃣ ارقام یکان: ۴ + ۸ = ۱۲ → مینویسیم ۲ و ۱ دهدهی 2️⃣ دهگانها: ۳ + ۷ = ۱۰ + ۱ دهدهی = ۱۱ → مینویسیم ۱ و ۱ دهدهی 3️⃣ صدگانها: ۲ + ۶ = ۸ + ۱ دهدهی = ۹ 4️⃣ هزارگانها: ۱ + ۵ = ۶ ➡️نتیجه نهایی: ۶۹۱۲ |

چرا Chain-of-Thought مهم است؟

Chain-of-Thought فقط یک روش جذاب برای گرفتن جواب نیست، بلکه چیزی فراتر از پاسخ نهایی است. وقتی مدلها یاد میگیرند مرحله به مرحله فکر کنند، مزایای زیادی دارد:

- بهبود دقت

با تجزیه مسائل پیچیده به مراحل کوچکتر، احتمال خطای مدل به شدت کاهش پیدا میکند. به جای اینکه مدل مستقیماً یک جواب بدهد و ممکن است اشتباه کند، با هر گام بررسی میکنیم که محاسبات و استدلالها درست هستند یا نه. - شفافیت بیشتر

CoT به شما اجازه میدهد روند فکر کردن مدل را ببینید. این شفافیت باعث میشود کاربران بهتر بفهمند چرا مدل به یک پاسخ رسیده و تصمیماتش قابل اعتمادتر شود. - کاهش خطاهای استدلالی

وقتی مراحل استدلال به صورت گام به گام ارائه میشوند، احتمال خطا در تصمیمگیریهای پیچیده کمتر میشود. این روش به خصوص در مسائل ریاضی، منطقی و تصمیمگیریهای چندمرحلهای فوقالعاده کاربردی است. - قابل استفاده در کاربردهای واقعی

CoT نه تنها دقت و شفافیت را بالا میبرد، بلکه میتواند در برنامهنویسی، تحلیل داده و حتی نوشتن متنهای پیچیده کمک کند، چون مدل دقیقاً روند فکری خودش را با شما به اشتراک میگذارد.

انواع Chain-of-Thought Prompting

Chain-of-Thought انواع مختلفی دارد که هرکدام برای شرایط خاصی مناسب هستند. بیایید با هم مرور کنیم:

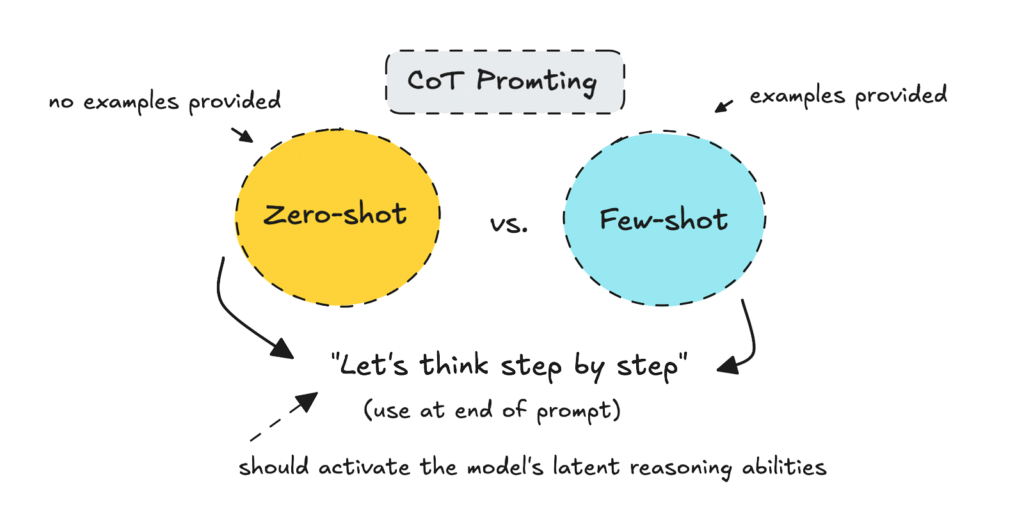

- Zero-shot CoT

- بدون نیاز به نمونههای قبلی، با افزودن عباراتی مثل “Let’s think step by step”، مدل را تشویق میکنیم که پاسخ خود را گام به گام توضیح دهد.

- عالی برای زمانی که میخواهید مدل را سریع و بدون آمادهسازی خاصی استفاده کنید.

- Few-shot CoT

- در این روش چند نمونه از پاسخهای گامبهگام را به مدل میدهیم تا الگو یاد بگیرد.

- مناسب برای مسائل پیچیده که نمونهها میتوانند کیفیت پاسخ را بهبود دهند.

- Contrastive CoT

- در این روش، مدل هم نمونههای درست و هم نادرست را میبیند تا اشتباهات رایج را تشخیص دهد.

- کمک میکند که مدل از الگوهای نادرست اجتناب کند و پاسخهای دقیقتری بدهد.

- Faithful CoT

- این نوع CoT تضمین میکند که استدلال مدل با پاسخ نهایی همخوانی داشته باشد.

- بسیار مفید برای سناریوهایی که هم دقت پاسخ و هم روند استدلال اهمیت دارد.

- Automatic CoT

- تولید خودکار استدلالهای گامبهگام با استفاده از الگوریتمها و هوش مصنوعی.

- به شما اجازه میدهد بدون دخالت دستی، روند فکری مدل را به صورت خودکار دریافت کنید.

مثالهای عملی

- برای اینکه Chain-of-Thought (CoT) را بهتر درک کنیم، بیایید چند مثال واقعی بررسی کنیم و ببینیم مدل چطور میتواند با استدلال گامبهگام پاسخ دهد:

| حوزه | نوع مثال | توضیح CoT |

| مسائل ریاضی | جمع، ضرب، معادلات | مدل هر مرحله محاسبه را توضیح میدهد، مثل جمع ارقام یکان، دهگان و … و در نهایت نتیجه نهایی را ارائه میدهد. این روش باعث کاهش خطا در محاسبات پیچیده میشود. |

| مسائل منطقی | پازلها، شرطها، قیاسها | مدل ابتدا روابط منطقی بین عناصر را بررسی میکند، سپس مرحله به مرحله نتیجهگیری میکند. مثال: اگر A قبل از B باشد و B قبل از C، نتیجه نهایی چیست؟ مدل با توضیح هر گام جواب میدهد. |

| تحلیل دادهها | دادههای آماری، روندها، پیشبینی | مدل دادهها را مرحله به مرحله تحلیل میکند: بررسی مقدارها، محاسبه میانگین یا شاخصهای آماری، شناسایی روندها و در نهایت ارائه نتیجه یا پیشبینی. این کار شفافیت تحلیل را بالا میبرد و خطاهای احتمالی را کاهش میدهد. |

| برنامهنویسی و رفع خطا | تشخیص باگ، تحلیل کد | مدل کد را خط به خط بررسی میکند، احتمالات خطا را مشخص میکند و پیشنهادهای اصلاح میدهد. CoT باعث میشود کاربر بفهمد چرا یک خطا رخ داده و چگونه میتوان آن را اصلاح کرد. |

| تحلیل متنی و زبان طبیعی | خلاصهسازی، استخراج اطلاعات | مدل متن را به بخشهای کوچکتر تقسیم کرده و مرحله به مرحله تحلیل میکند: شناسایی جملات کلیدی، استخراج دادهها، و در نهایت تولید پاسخ یا خلاصه. |

مزایا و محدودیتها

مزایا

- افزایش دقت در کارهای پیچیده

CoT اجازه میدهد مدل مسائل چندمرحلهای را به بخشهای کوچکتر بشکند و هر بخش را مستقل ارزیابی کند — این یعنی خطا در کل روند کمتر خواهد شد. - شفافیت بیشتر در استدلال

وقتی مدل مراحل فکری خودش را به کاربر نشان میدهد، امکان بررسی و اعتماد بیشتر فراهم میشود. - قابلیت استدلال چندمرحلهای (Multistep Reasoning)

در مسائل که نیاز به پیشفرضها، تصمیمات بینابینی و تحلیل گامبهگام دارند، CoT عملکرد بهتری نسبت به پرامپت ساده دارد. - پوشش گستردهتر دامنه وظایف

CoT را میتوان در حوزههای مختلفی مثل منطق، ریاضیات، تحلیل داده و استخراج دانش به کار برد. - تقویت قابلیت کنترل و تبیین نتایج

بیش از اینکه فقط نتیجه نهایی ببینی، میتوانی بفهمی چه مراحلی طی شده تا به آن نتیجه برسد — این برای کاربردهایی که پاسخ باید قابل بررسی باشد، بسیار مفید است.

محدودیتها و چالشها

- پاسخهای طولانیتر و پیچیدگی بیشتر

وقتی مدل باید پشت هر پاسخ، یک زنجیره استدلال بدهد، متنی بلند به وجود میآید که ممکن است برای خواننده خستهکننده شود یا حوصله کاربر را ببرد. - نیاز به توان محاسباتی بیشتر

تولید و پردازش استدلالهای میانی نیاز به زمان و منابع محاسباتی بیشتری دارد. - احتمال استدلالهای نادرست

مدل ممکن است در یک قدم خطا کند و آن خطا در گامهای بعدی انتشار یابد و نتیجه کلی را مخدوش کند. - وابستگی زیاد به کیفیت پرامپتها

اگر پرامپتها دقیق، روشن و هدفمند نباشند، مدل ممکن است منطق ضعیفی تولید کند یا از مسیر اشتباه منحرف شود. - محدودیت برای مدلهای کوچکتر

برای مدلهایی با پارامتر کمتر، عملکرد CoT ممکن است بهتر از پرامپت ساده نباشد یا استدلالهای بیمعنی تولید کند. - حساسیت به متنهای نامرتبط یا حواسپرتی

قرار دادن متن نامربوط در پرامپت یا زمینه ممکن است مدل را منحرف کند و بر دقت استدلال تأثیر منفی بگذارد.

بهترین شیوههای استفاده از Chain-of-Thought

برای اینکه از CoT بهترین نتیجه را بگیری، رعایت چند نکته بسیار مؤثر است:

انتخاب عبارات تحریککننده مناسب

عباراتی مثل “Let’s think step by step”, “Explain your reasoning” یا “Step by step, why …” به مدل کمک میکنند واضحتر استدلال کند.

استفاده ترکیبی با Few-shot (نمونههای استدلالی)

دادن چند نمونه از پاسخهایی که شامل مراحل هستند، باعث میشود مدل الگوی صحیح را بهتر درک کند.

کوتاه و دقیق بودن پرامپت

پرامپت طولانی و پیچیده ممکن است سردرگمی ایجاد کند؛ بهتر است پرامپتها مختصر، هدفمند و روشن باشند.

تفکیک گامها منطقی و منظم

هر مرحله باید ارتباط منطقی با مرحله قبل داشته باشد؛ گذارها باید روان و قابل دنبال کردن باشند.

بررسی و بازبینی استدلال تولید شده

حتی وقتی مدل استدلال میدهد، ممکن است خطا کرده باشد؛ پس همیشه استدلالها را مرور کن و در صورت نیاز اصلاح کن.

استفاده از استراتژیهای تکمیلی مثل Self-Consistency

در برخی پژوهشها، روشهایی مانند self-consistency استفاده شدهاند که چند مسیر استدلال میسازند و مسیرهایی که بیشتر به هم میرسند را انتخاب میکنند تا دقت بالاتر رود.

آزمون روشها در نمونههای متنوع

قبل از استفاده در پروژه واقعی، روشهای CoT مختلف (zero-shot، few-shot، contrastive) را روی چند نمونه امتحان کن تا ببینی کدام روش برای موضوع تو بهتر جواب میدهد.

کاربردهای واقعی Chain-of-Thought

تکنیک Chain-of-Thought فقط روی کاغذ جذاب نیست؛ در عمل هم میتواند تفاوت بزرگی ایجاد کند. برخی از مهمترین حوزههایی که CoT در آنها به کار میآید:

ریاضیات و منطق

وقتی پای مسائل چندمرحلهای مثل معادلات، اثباتها یا پازلهای منطقی وسط باشد، CoT کمک میکند مدل به جای یک جواب سریع، قدمبهقدم فکر کند و به نتیجه برسد.

پرسش و پاسخهای پیچیده

برای سوالاتی که تنها یک جواب مستقیم ندارند و نیاز به تحلیل و نتیجهگیری دارند (مثل «چرا این تصمیم منطقیتر است؟»)، CoT باعث میشود پاسخ شفافتر و مستدلتر باشد.

تحلیل داده و مدلسازی

مدل میتواند دادهها را لایهبهلایه بررسی کند: از خلاصهسازی توزیع و شناسایی روندها گرفته تا انتخاب روش آماری مناسب و نتیجهگیری نهایی. این کار باعث میشود تحلیلها قابل فهمتر و دقیقتر باشند.

برنامهنویسی و رفع خطا

به جای اینکه فقط یک خط کد بهعنوان جواب پیشنهاد شود، مدل میتواند کد را خط به خط بررسی کرده، مشکل را شناسایی کند و گامبهگام توضیح دهد که چطور باید اصلاح شود.

حوزههای حساس مثل پزشکی و حقوق

وقتی شفافیت اهمیت بالایی دارد (مثلاً در تحلیل حقوقی یا تصمیمگیریهای پزشکی)، CoT کمک میکند دلیل پشت هر پیشنهاد یا نتیجه قابل توضیح باشد و اعتماد به مدل افزایش پیدا کند.

چتباتها و دستیارهای هوشمند

در مکالمات پیچیده، CoT باعث میشود پاسخها نه فقط دقیق، بلکه منسجم و قابل توضیح باشند. این یعنی کاربر حس میکند با یک دستیار فکرشده و حرفهای صحبت میکند، نه صرفاً یک ماشین جوابگو.

جمعبندی

- Chain-of-Thought تکنیکی بسیار قدرتمند است که با شفافسازی روند استدلال و تقسیم مسائل به مراحل کوچکتر، دقت و اعتماد در خروجی مدلها را بهبود میدهد.

- اما CoT هم محدودیتهایی دارد: پاسخهای طولانیتر، نیاز به منابع بیشتر، احتمال خطا در استدلال و وابستگی به کیفیت پرامپت.

- با رعایت بهترین شیوهها مثل استفاده از عبارات تحریککننده، نمونهسازی مناسب، بازبینی استدلالها و ترکیب روشها، میتوان از این تکنیک در پروژههای واقعی بهره برد.

- آینده پیشبینیشده CoT این است که با تحقیق بیشتر، روشهای خودکارتر، بهینهتر و قابل اعتمادتر به وجود بیاید و در زمینههای بیشتری کاربرد پیدا کند.